FeelAnyForce 突破标定瓶颈,GelSight Mini 成视触觉通用模型核心基准

马里兰大学与意大利理工学院联合团队推出 FeelAnyForce 模型,成功突破视触觉传感器 “一机一标定” 的行业瓶颈,依托Gelsight Mini完成基准训练,实现Gelsight 视触觉传感器与 Digit传感器的高效跨设备适配,显著降低触觉感知部署成本。

一、行业痛点:单设备标定耗时且无法迁移

当前Gelsight 视触觉传感器、Digit 等主流设备,将触觉图像转换为力信号时,需针对单台设备单独标定数日,流程繁琐且模型与设备强绑定,无法跨设备复用,制约机器人触觉感知规模化落地。

二、核心突破:学习 “形变⇋力” 底层物理规律

FeelAnyForce 摒弃传统单设备标定思路,聚焦视触觉传感器共通的光学成像原理与 “形变⇋力” 转换逻辑,让 AI 学习底层物理规律而非设备专属特征。

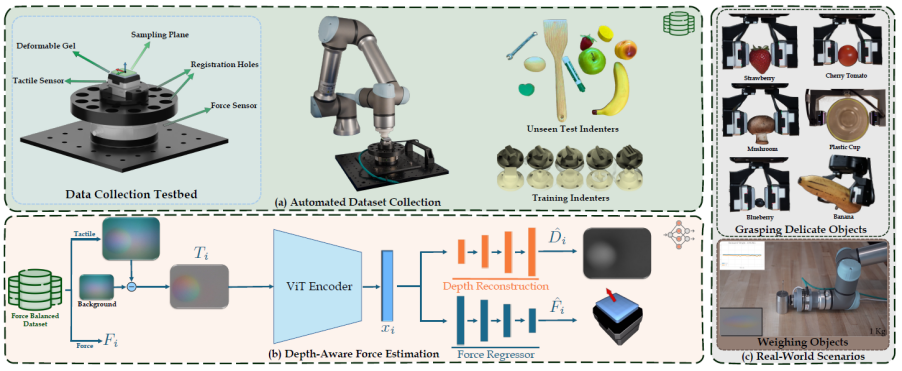

研究团队以Gelsight Mini为基准平台,搭配 UR 机械臂与六维力传感器搭建自动化采集系统,完成20万组真实数据采集,覆盖点/边/面多类接触场景。

三、关键技术:双任务学习 + 渐进式适配

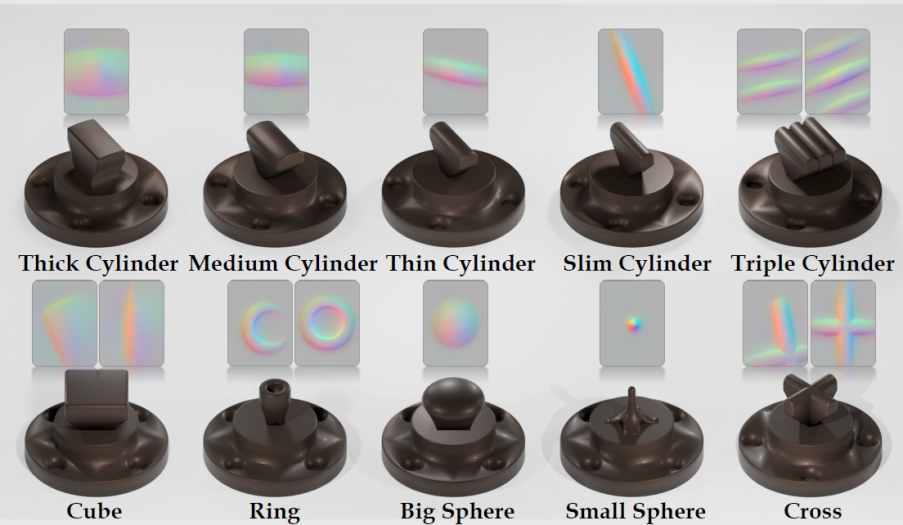

- 数据采集:采用 10 种 3D 打印压头开展多角度压痕测试,保障模型学习通用接触规律

- 模型设计:力预测 + 深度重建双任务学习,强制编码器提取物理本质特征

- 训练策略:DINOv2 预训练 ViT 主干→真实数据微调→跨设备小样本适配,Gelsight Mini领域内力估计误差降至 4.2%

四、为什么选用GelSight Mini做基准?

- 深度原生:独创光度立体法搭配透明凝胶体系,具备微米级精度,且与材料无关,是模型深度监督设计的关键基础。

- 机械一致:凝胶同心度<0.5mm,3×3 交叉验证误差稳定在 4.2%-6.3%,为 20 万组样本采集与跨设备泛化提供可靠数据保障。

- 学术认可:获全球顶尖实验室采用,支持 ROS/PyTouch 原生对接,5 分钟即插即用,技术成熟度高。

- 成像优质:可拍摄微米级超清触觉图像,精准捕捉凝胶形变信息。

五、实验验证:跨传感器性能稳定

- 同设备:Gelsight Mini 归一化 L1 误差 4.2%

- 换凝胶:Gelsight Mini 误差稳定 4.2%-6.3%

- 跨传感器:迁移至 Digit 误差 9.2%,远优于传统 ResNet 架构的 53.4%

模型可直接回归 0-15N 范围 3D 力向量,在静态测试、推物称重、易碎品抓取等场景表现稳定。

六、行业价值

该研究为跨传感器力标定提供全新范式,通过挖掘物理规律构建可泛化表征,为机器人通用触觉感知发展奠定基础,助力视触觉技术在机器人精密操作、智能抓取等场景落地。

论文链接:https://arxiv.org/pdf/2410.02048.pdf

项目主页:http://prg.cs.umd.edu/FeelAnyForce

创建时间:2026-03-23 11:05